启动完成后,可以通过命令 jps 来判断是否成功启动,若成功启动则会列出如下进程: NameNode、DataNode和SecondaryNameNode。(如果SecondaryNameNode没有启动,请运行 sbin/stop-dfs.sh 关闭进程,然后再次尝试启动尝试;如果 NameNode 或 DataNode 没有启动,请仔细检查之前步骤)。

hadoop@ubuntu:~/opt/hadoop-2.6.0$ jps

4576 Jps

4274 DataNode

4162 NameNode

4473 SecondaryNameNode

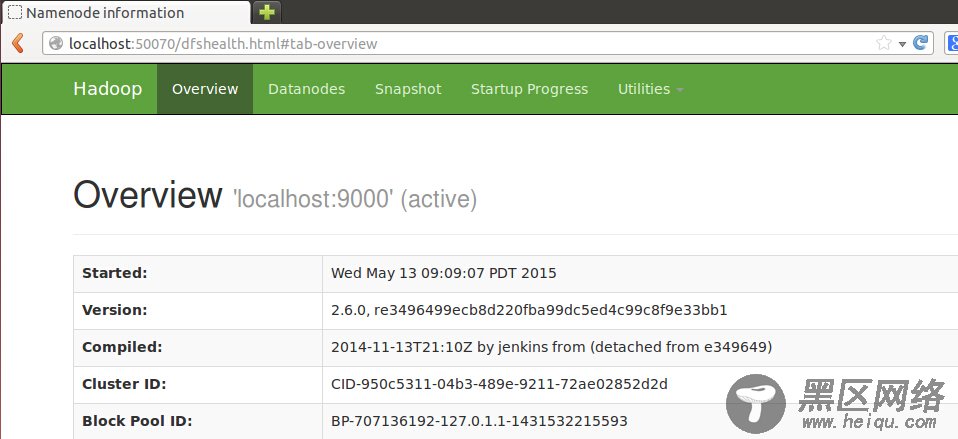

成功启动后,可以访问 Web 界面 :50070 来查看 Hadoop 的信息:

上面的单机模式,WordCount 读取的是本地数据,伪分布式读取的则是HDFS上的数据。要使用 HDFS,首先需要创建用户目录

hadoop@ubuntu:~/opt/hadoop-2.6.0$ bin/hdfs dfs -mkdir -p /user/hadoop

解释如下:

-mkdir [-p] <path> ... :

Create a directory in specified location.

-p Do not fail if the directory already exists

接着将 etc/hadoop 中的文件作为输入文件复制到分布式文件系统中,即将 /home/hadoop/opt/hadoop-2.6.0/etc/hadoop 复制到分布式文件系统中的 /user/hadoop/input 中。上一步已创建了用户目录 /user/hadoop ,因此命令中就可以使用相对目录如 input,其对应的绝对路径就是 /user/hadoop/input:

$ bin/hdfs dfs -mkdir input $ bin/hdfs dfs -put etc/hadoop/*.xml input

复制完成后,可以通过如下命令查看文件列表:

hadoop@ubuntu:~/opt/hadoop-2.6.0$ bin/hdfs dfs -ls input

Found 8 items

-rw-r--r-- 1 hadoop supergroup 4436 2015-05-13 18:26 input/capacity-scheduler.xml

-rw-r--r-- 1 hadoop supergroup 991 2015-05-13 18:26 input/core-site.xml

-rw-r--r-- 1 hadoop supergroup 9683 2015-05-13 18:26 input/hadoop-policy.xml

-rw-r--r-- 1 hadoop supergroup 1121 2015-05-13 18:26 input/hdfs-site.xml

-rw-r--r-- 1 hadoop supergroup 620 2015-05-13 18:26 input/httpfs-site.xml

-rw-r--r-- 1 hadoop supergroup 3523 2015-05-13 18:26 input/kms-acls.xml

-rw-r--r-- 1 hadoop supergroup 5511 2015-05-13 18:26 input/kms-site.xml

-rw-r--r-- 1 hadoop supergroup 690 2015-05-13 18:26 input/yarn-site.xml

伪分布式运行MapReduce作业的方式跟单机模式相同,区别在于伪分布式读取的是HDFS中的文件(可以将单机步骤中创建的本地 input 文件夹删掉来验证这一点)。

$ bin/hadoop jar share/hadoop/mapreduce/hadoop-mapreduce-examples-*.jar grep input output 'dfs[a-z.]+'

查看运行结果的命令(查看的是位于 HDFS 中的输出结果):

$ bin/hdfs dfs -cat output/*

也可以将运行结果取回到本地:

$ rm -R ./output $ bin/hdfs dfs -get output output # 将 HDFS 上的 output 文件夹拷贝到本机 $ cat ./output/*

结果如下:

1 dfsadmin

1 dfs.replication

1 dfs.namenode.name.dir

1 dfs.datanode.data.dir

Hadoop运行程序时,默认输出目录不能存在,因此再次运行需要执行如下命令删除 output文件夹:

$ bin/hdfs dfs -rm -r /user/hadoop/output # 删除 output 文件夹

Ubuntu14.04下Hadoop2.4.1单机/伪分布式安装配置教程