Lucene的IK分词器早在2012年已经没有维护了,现在我们要使用的是在其基础上维护升级的版本,并且开发为ElasticSearch的集成插件了,与Elasticsearch一起维护升级,版本也保持一致,最新版本:6.3.0

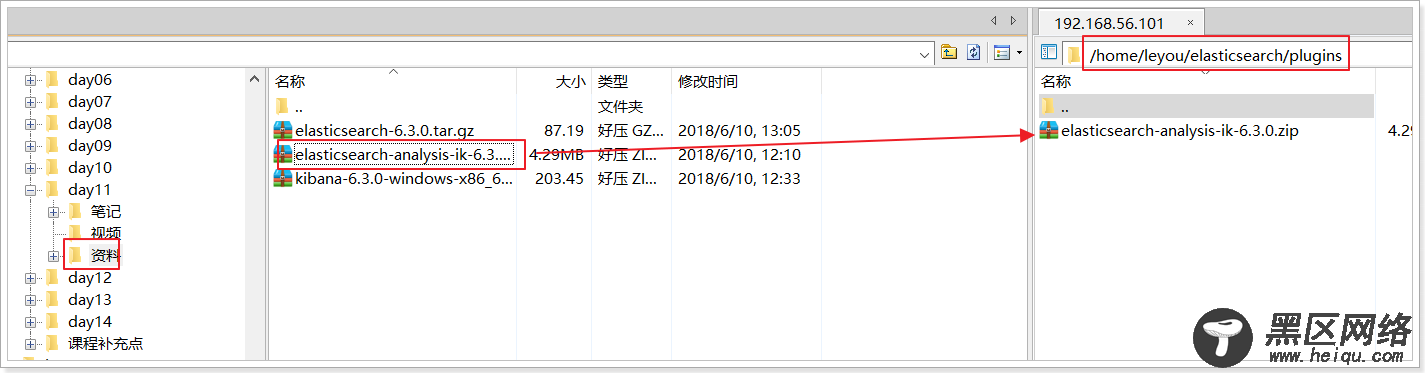

1.5.1.安装上传资料中的zip包,解压到Elasticsearch目录的plugins目录中:

使用unzip命令解压:

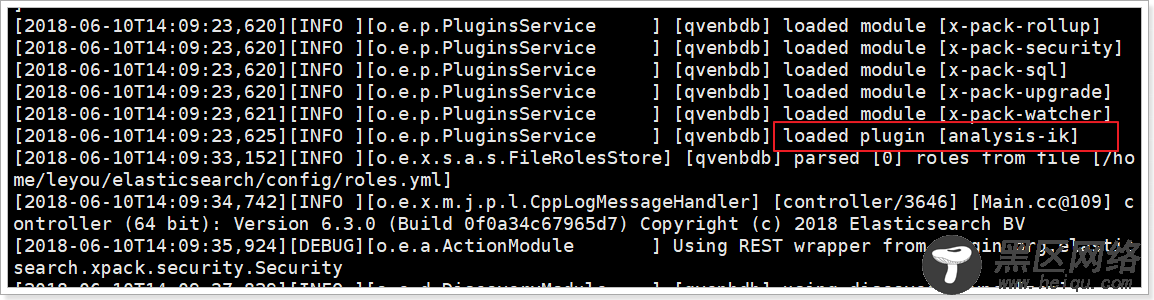

unzip elasticsearch-analysis-ik-6.3.0.zip -d ik-analyzer然后重启elasticsearch:

大家先不管语法,我们先测试一波。

在kibana控制台输入下面的请求:

POST _analyze { "analyzer": "ik_max_word", "text": "我是中国人" }运行得到结果:

{ "tokens": [ { "token": "我", "start_offset": 0, "end_offset": 1, "type": "CN_CHAR", "position": 0 }, { "token": "是", "start_offset": 1, "end_offset": 2, "type": "CN_CHAR", "position": 1 }, { "token": "中国人", "start_offset": 2, "end_offset": 5, "type": "CN_WORD", "position": 2 }, { "token": "中国", "start_offset": 2, "end_offset": 4, "type": "CN_WORD", "position": 3 }, { "token": "国人", "start_offset": 3, "end_offset": 5, "type": "CN_WORD", "position": 4 } ] }软件包下载: