使用IntelliJ IDEA编写Scala在Spark中运行

使用Scala写一个测试代码:

object Test {

def main(args: Array[String]): Unit = {

println("hello world")

}

}

就把这个Test视为类,项目组织结构如:

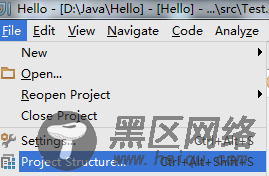

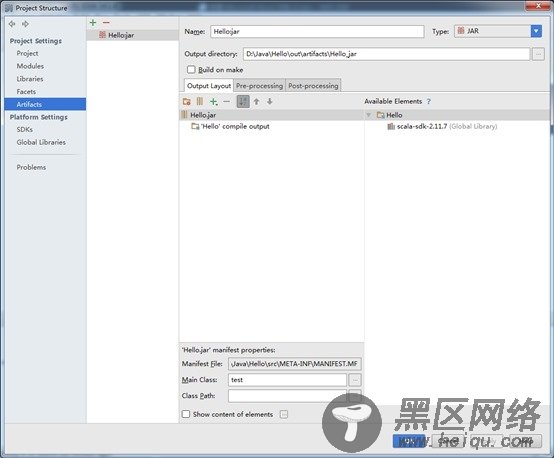

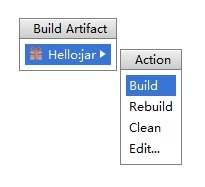

然后设置编译选项:

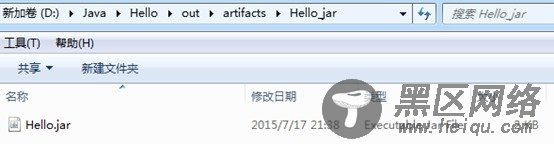

然后在项目文件夹下面可以找到编译好的Jar包:

复制到Spark指定的目录下(自己建的):

启动Spark,然后提交任务:

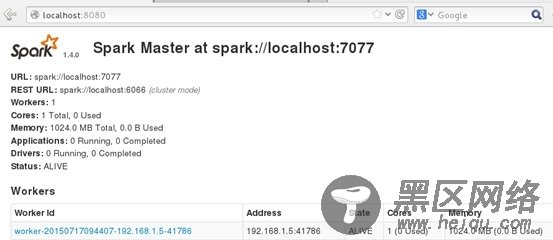

spark-submit --class Test --master spark://localhost:7077 /home/data/myjar/Hello.jar

从上面控制台中已经能够看到执行的输出信息,同样,我们也可在web管理器中查看任务信息:

接下来的事情就只剩下编写Scala程序实现自己的算法了。

Ubuntu 安装 2.10.x版本的Scala

CentOS 6.2(64位)下安装Spark0.8.0详细记录

Hadoop vs Spark性能对比