本教程基于 Hadoop 2.4.1,但应该适用于所有 2.x 版本。我在 Ubuntu 下多次安装过,按照本教程一般都可以配置成功。本教程只是基础的安装配置,更多功能、配置、技巧就需要各位自行探索了。

环境系统: Ubuntu 14.04 64bit

Hadoop版本: hadoop 2.4.1 (stable)

JDK版本: OpenJDK 7

集群环境: 两台主机,一台作为Master,局域网IP为192.168.1.121;另一台作为Slave,局域网IP为192.168.1.122.

准备工作先按照教程Hadoop安装教程2.4.1单机/伪分布式配置(见 ),在所有机器上配置hadoop用户、安装SSH server、安装Java环境,在Master主机上安装Hadoop。

Hadoop的安装配置只需要在Master节点主机上进行,配置好后再复制到各个节点。

建议先按照上面的教程在Master主机上安装一次单机环境的Hadoop,如果直接上手集群,在Master主机上安装Hadoop时,要记得修改hadoop文件的权限。

CentOS安装和配置Hadoop2.2.0

Ubuntu 12.10 +Hadoop 1.2.1版本集群配置

搭建Hadoop环境(在Winodws环境下用虚拟机虚拟两个Ubuntu系统进行搭建)

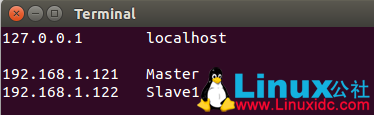

网络配置我使用了两台主机搭建集群,主机名与IP地址对应如下:

Master 192.168.1.121

Slave1 192.168.1.122

首先选定哪台主机要作为Master(比如我选择的是ip为 192.168.1.121 这台),然后在该主机的 /etc/hostname 中,修改机器名为Master,将其他主机命令为Slave1、Slave2等。接着在 /etc/hosts 中,把所有集群的主机信息都写进去。

sudo vim /etc/hostname sudo vim /etc/hosts完成后,如下图所示(/etc/hosts 中只能有一个127.0.0.1,对应为localhost,否则会出错)。最好重启一下,在终端中才会看到机器名的变化。

注意,该网络配置需要在所有主机上进行

如上面讲的是 Master 主机的配置,而在其他的 Slave 主机上,也要对 /etc/hostname(修改为 Slave1、Slave2等) 和 /etc/hosts(一般跟 Master 上的配置一样) 这两个文件进行相应的修改!

配置好后可以在各个主机上执行ping Master和ping Slave1测试一下,看是否相互ping得通。

这个操作是要让Master节点可以无密码SSH登陆到Slave节点上。

首先生成 Master 的公匙,在 Master 节点终端中执行:

cd ~/.ssh # 如果没有该目录,先执行一次ssh localhost ssh-keygen -t rsa # 一直按回车就可以,生成的密钥保存为.ssh/id_rsaMaster 节点需能无密码 ssh 本机,这一步还是在 Master 节点上执行:

cat ~/.ssh/id_rsa.pub >> ~/.ssh/authorized_keys完成后可以使用 ssh Master 验证一下。接着将公匙传输到 Slave1 节点:

scp ~/.ssh/id_rsa.pub hadoop@Slave1:/home/hadoop/scp时会要求输入Slave1上hadoop用户的密码(hadoop),输入完成后会提示传输完毕。

接着在 Slave1节点 上将ssh公匙保存到相应位置,执行

cat ~/id_rsa.pub >> ~/.ssh/authorized_keys如果有其他 Slave 节点,也要执行 将公匙传输到 Slave 节点、在 Slave 节点上加入授权 这两步。

最后在 Master 节点上就可以无密码SSH到Slave1节点了。

ssh Slave1 配置集群/分布式环境集群/分布式模式需要修改 etc/hadoop 中的5个配置文件,后四个文件可点击查看官方默认设置值,这里仅设置了正常启动所必须的设置项: slaves、core-site.xml、hdfs-site.xml、mapred-site.xml、yarn-site.xml 。

1, 文件 slave

cd /usr/local/hadoop/etc/hadoop vim slaves将原来 localhost 删除,把所有Slave的主机名写上,每行一个。例如我只有一个 Slave节点,那么该文件中就只有一行内容: Slave1。

2, 文件 core-site.xml ,将原本的如下内容:

<property> </property>