机器学习,这个名词大家都耳熟能详。虽然这个概念很早就被人提出来了,但是鉴于科技水平的落后,一直发展的比较缓慢。但是,近些年随着计算机硬件能力的大幅度提升,这一概念慢慢地回到我们的视野,而且发展速度之快令很多人刮目相看。尤其这两年,阿法狗在围棋届的神勇表现,给人在此领域有了巨大的遐想空间。

所谓机器学习,一般专业一点的描述其是:机器学习(Machine Learning, ML)是一门多领域交叉学科,涉及概率论、统计学、逼近论、凸分析、算法复杂度理论等多门学科。专门研究计算机怎样模拟或实现人类的学习行为,以获取新的知识或技能,重新组织已有的知识结构使之不断改善自身的性能。

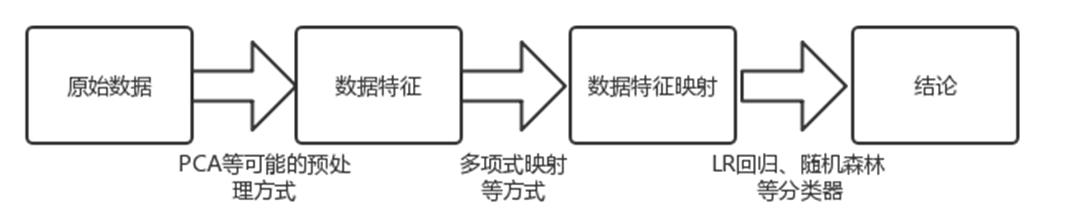

机器学习这门技术是多种技术的结合。而在这个结合体中,如何进行数据分析处理是个人认为最核心的内容。通常在机器学习中,我们指的数据分析是,从一大堆数据中,筛选出一些有意义的数据,推断出一个潜在的可能结论。得出这个不知道正确与否的结论,其经过的步骤通常是:

1、预处理:把数据处理成一些有意义的特征,这一步的目的主要是为了降维。

2、建模:这部分主要是建立模型(通常是曲线的拟合),为分类器搭建一个可能的边界。

3、分类器处理:根据模型把数据分类,并进行数据结论的预测。

本文讲的主要是数据的预处理(降维),而这里采用的方式是PCA。

PCA的个人理论分析:假设有一个学生信息管理系统,里面需要存储人性别的字段,我们在数据库里可以有M、F两个字段,用1、0分别代表是、否。当是男学生的时候其中M列为1,F列为0,为女生时M列为0,F列为1。我们发现,对任意一条记录,当M为1,F必然为0,反之也是如此。因此实际过程,我们把M列或F列去掉也不会丢失任何信息,因为我们可以反推出结论。这种情况下的M、F列的关联比是最高的,是100%。

再举另外一个例子,小明开了家店铺,他每天在统计其店铺的访问量V和成交量D。可以发现,往往V多的时候,D通常也多。D少的时候,V通常也很少。可以猜到V和D是有种必然的联系,但又没有绝对的联系。此时小明如果想根据V、D来衡量这一天的价值,往往可以根据一些历史数据来计算出V、D的关联比。拍脑门说一个,如果关联比大于80%,那么可以取VD其中任意一个即可衡量当天价值。这样就达到了降维的效果。

当然降维并非只能在比如说2维数据[V,D]中选取其中的1维[V]作为特征值,它有可能是在V+D的情况下,使得对[V, D]的关联比最大。

但是PCA思想就是如此。简单点说:假设有x1、x2、x3…xn维数据,我们想把数据降到m维,我们可以根据这n维的历史数据,算出一个与x1…xn相关m维数据,使得这个m维数据对历史数据的关联比达到最大。

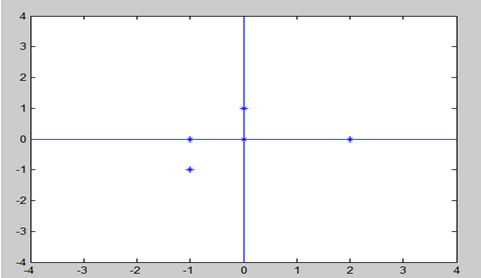

数学分析假设我们有一组二维数据

如果我们必须使用一维来表示这些数据,又希望尽量保留原始的信息,你要如何选择?

这个问题实际上是要在二维平面中选择一个方向,将所有数据都投影到这个方向所在直线上,用投影值表示原始记录。这是一个实际的二维降到一维的问题。

那么如何选择这个方向才能尽量保留最多的原始信息呢?一种直观的看法是:希望投影后的投影值尽可能分散,这样投影的范围越大,在做分类的时候也就更容易做分类器。

以上图为例,可以看出如果向x轴投影,那么最左边的两个点会重叠在一起,中间的两个点也会重叠在一起,于是本身四个各不相同的二维点投影后只剩下两个不同的值了,这是一种严重的信息丢失。同理,如果向y轴投影中间的三个点都会重叠,效果更糟。所以看来x和y轴都不是最好的投影选择。直观来看,如果向通过第一象限和第三象限的斜线投影,则五个点在投影后还是可以区分的。

我们希望投影后投影值尽可能分散,那什么是衡量分散程度的统计量呢,显然可以用数学上的方差来表述。

通常,为了方便计算,我们会把每个点都减去均值,这样得到的点的均值就会为0.这个过程叫做均一化。均一化后:

于是上面的问题被形式化表述为:寻找一个基,使得所有数据变换为这个基上的坐标表示后,方差值最大。

我们跳出刚才的例子,因为很容易把刚才的结论推广到任意纬度。要求投影点的方差最大值所对应的基u,这时有两种方法来求解:

方法一:

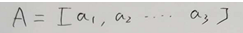

假设有个投影A:

显然刚才说的方差V可以用来表示:

而投影A = 原始数据X . U;

这样方差可以表示为:

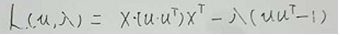

求这个方差的最大值,我们可以用拉格朗日插值法来做

L(u,λ)为:

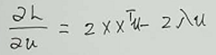

求导L’:

令导数为0:

这样问题就转换成求X.XT的特征值和特征向量,问题就迎刃而解了。