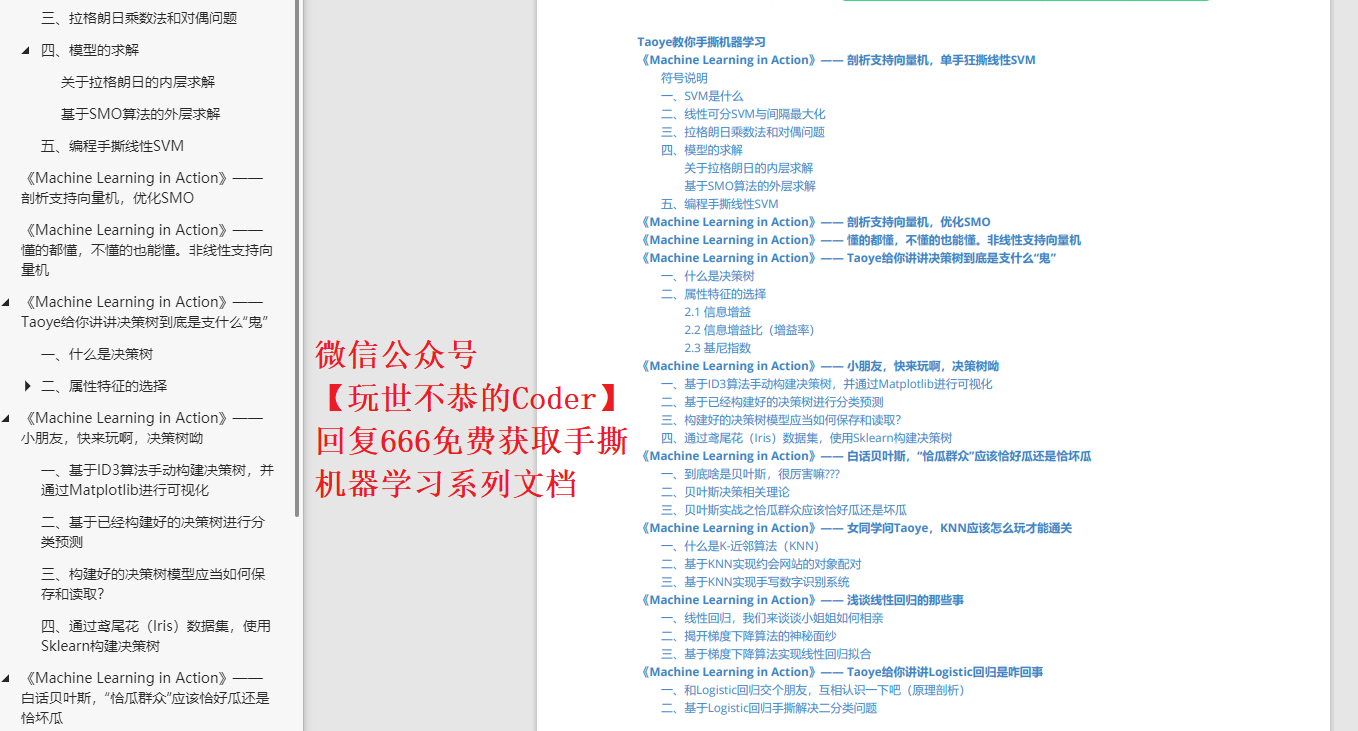

手撕机器学习系列文章就暂时更新到此吧,目前已经完成了支持向量机SVM、决策树、KNN、贝叶斯、线性回归、Logistic回归,其他算法还请允许Taoye在这里先赊个账,后期有机会有时间再给大家补上。

更新至此,也是收到了部分读者的好评。虽然不多,但还是非常感谢大家的支持,希望每一位阅读过的读者都能够有所收获。

该系列文章的全部内容都是Taoye纯手打,也是参考了不少书籍以及公开资源,系列总字数在15W左右(含源码),总页数为138,后期会再慢慢填补,更多的技术文章可以来访Taoye的公众号:玩世不恭的Coder。文档可以随意传播,但注意不可修改其中的内容。

如果文章中有任何不懂的问题,都可以直接提出,Taoye看见后会第一时间回复,同时欢迎大家来此私密地向Taoye催更:玩世不恭的Coder,公众号也有Taoye的私人联系方式。有些话,Taoye只能在那里和你偷偷地说 (#`O′)

为了提高大家的阅读体验,手撕机器学习系列文章Taoye已经整理成PDF和和HTML,阅读效果都很不错,在公众号【玩世不恭的Coder】下回复【666】即可免费获取,相信大家看完后一定会有所收获

后期的计划就是更新深度学习相关的内容,关于深度学习,Taoye认为最好的学习方式(入门)就是自己手动实现,包括其原理以及代码部分(能实现就尽可能的实现)。在实现的同时中要不断思考其过程,这样非常有助于正确理解深度学习。

所以,该系列文章前期会尽可能从零开始来肝深度学习,而非一上来就搬出像Tensorflow、Keras、Caffe等这种“黑盒子”。

本篇文章主要是讲解感知器,同时也是为后面神经网络的内容打好基础,该文主要包括以下三个部分的内容:

到底什么是感知器啊

如何基于感知器实现逻辑电路以及异或问题的抛出

基于两层感知器完美解决异或问题

一、到底什么是感知器啊我们不妨先从其表面来初步理解一下感知器吧。

“感知器,感知器”,既然它是带有一个“器”字,那么我们不妨将其看做一个“机器”?

既然是个机器,那么它能必然能代替人工来实现一些我们所需要的功能,且我们能够人为的提交某些“东西”给它,而它同时也能根据我们所提供的“东西”给我们一些反馈。

是这样的嘛???

没毛病,兄dei,就是这样的。

感知器它能接收多个输入信号,并且根据这多个信号输出一个信号。这里的输入信号可以理解成我们给感知器提供的一些“东西”,或者说是数据(相信有阅读过Taoye的手撕机器学习系列文章的读者都能轻松明白吧),而输出信号则可以理解成经过感知器这个“机器”处理过后所得到的结果。

在上图感知器中,其接收了两个输入信号\(x_1, x_2\),并通过\(w_1,w_2\)处理过后输出一个信号\(y\)。其中\(w_1,w_2\)表示权重,权重越高,体现的是信号的重要性就越高,而每个圆圈代表一个“节点”或者说是“神经元”。输入信号\(x_1,x_2\)被输入到神经元之后,会分别乘以对应的权重\(w_1,w_2\),并求和得到\(w_1x_1+w_2x_2\),假如这个总和超过某个界限\(\theta\)的时候,此时输出信号\(y=1\),否则输出信号\(y=0\),这里的界限\(\theta\)我们也可以理解成阈值或是门槛,体现的是神经元被激活的难易程度。

用数学表达上述过程如下:

\[ y = \begin{cases} 0, & w_1x_1+w_2x_2 \leq \theta\\ 1, & w_1x_1+w_2x_2 > \theta \\ \end{cases} \]