(1)数据处理:IEMOCAP数据四分类,train:validate:test=0.55:0.25:0.2。所有utterance切分或填充到7.5s,提取LLDs特征log-Melfilterbank四十维特征,窗长分别为25ms,窗移10ms。

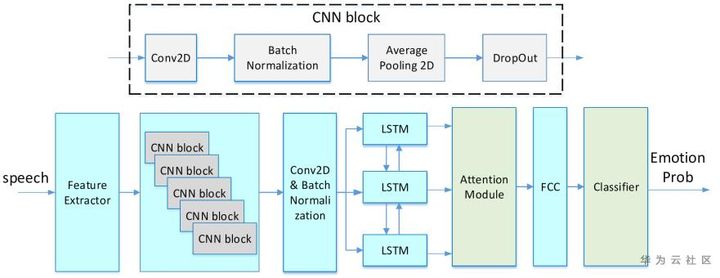

(2)模型方法:输入语谱图,六个CNN block重头到尾进行卷积,提取特征;之后出入到LSTM序列建模,Attention模块对LSTM的输入进行选择权重,最后全连接层再softmax分类。

(3)实验:UA达到62.3%,比baseline的效果低(67.4%),但论文重点在于模型轻(参数量小于360K),计算快。另一个验证Additive margin softmax loss, Focal loss跟attention pooling效果相当,都能达到66%左右。

(4)总结:论文的创新不在网络结构,而是采用不同loss的效果。

(1)数据处理:IEMOCAP数据人工加入噪音,CHEAVD数据本生存在噪音,因此不用加噪音。

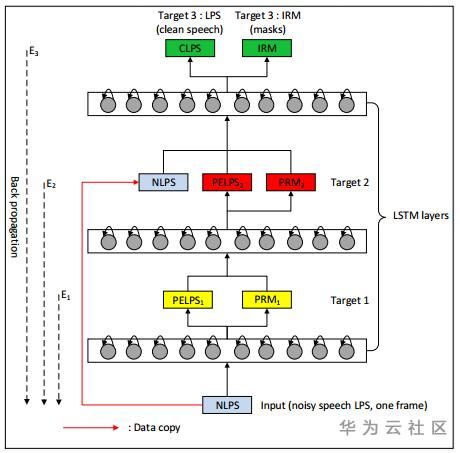

(2)模型方法:本文章是一个语音增强模型。输入带噪频谱,目标是生成纯净语音的频谱以及ideal ratio mask,中间有三层的LSTM层,每层会生成一些频谱特征以及相应的mask。最后一层输出生成的纯净语音频谱和IRM。

(3)实验:前者IEMOCAP数据和WSJ0数据一起用于训练语音增强模型,然后对IEMOCAP的测试集(加噪音后)进行情绪预测。后者语音增强模型首先在1000小时语料上训练好,然后对CHEAVD数据进行增强,增强后的语音用于语音情感识别。

(4)总结:语音增强模型在含语音情感的数据上训练后,对于带噪的语音情感识别任务效果显著;在一些低信噪比、低能量和笑声的片段中,语音增强后往往会被扭曲(distorted),SER效果可能会下降。

(1)数据处理:日本JAIST录制的语音数据,四个人(两男两女),每人表达4种情绪(生气、愉悦、中性、悲伤)。发音为元音a。

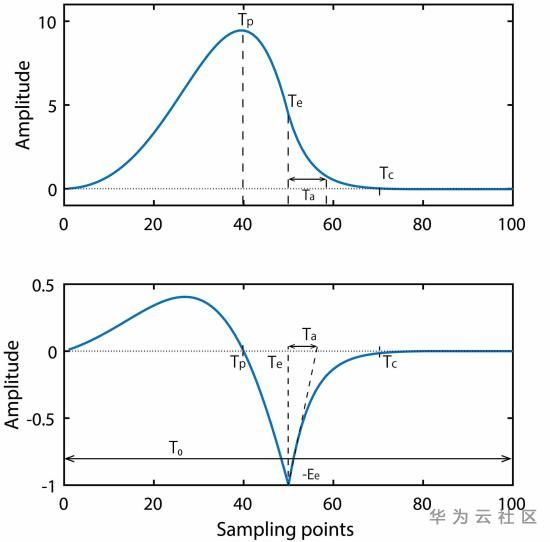

(2)模型方法:ARX-LF模型,the ARX-LF model has been widely used for representing glottal source waves and vocal tract filter。

(3)实验:对声门音(glottal source)的波形(waveform)分析,发现悲伤的元音更圆滑而愉悦和生气的更陡峭。统计参数(parameters)Tp, Te, Ta, Ee, F0(1/T0)发现,基频F0对不同情绪差异显著。

(4)总结:偏传统语言情感研究的方向,研究声门音对情绪的表达情况,具有探索性,在全面DL的趋势下,难能可贵。后续可对这些数据进行DL建模,也许是一个方向。但是难度在于声门音的收集与标注,目前的实验数据较为稀少且人工录制,成本高,数据量少。

(1)数据处理:IEMOCAP数据和NNIME数据,对valence、activation的评分1-5分别划成low/middle/high三个离散类别。特征源自openSMILE的45维特征,含MFCC、F0和响度等。

(2)模型方法:对于每一段音频,每人对它的情绪感知不一样,传统采用投票机制,选择众数作为唯一标签。本文采用不同的策略,对每个人的情感标签进行预测。基本模型是BLSTM-DNN模型,下图中的(a)部分。训练数据的标签分成三部分,一个是每个人的硬标签(唯一),另外两个是除了该目标人的其他人的软标签和硬标签。三类标签数据分别用BLSTM-DNN模型单独训练。然后冻结BLSTM-DNN参数,将各BLSTM-DNN的dense layer层的输出拼接,再叠加三个Dense layers,最后softmax到个人的硬标签。因此预测阶段,每个人有对应的情绪感知,当存在N个人的话,将有N个模型。