麦克菲(McAfee)在去年说,随着更多的黑客通过相互合作来巩固他们的生态系统,更加强大的恶意软件即服务将会出现(malware-as-a-service)。因此,公司及政府需要为这样一个世界做好准备,在这个世界中,数据和信息安全将是唯一需要考虑的部分。同时我们还要将眼界放得更宽,宽到将所有人类的生命和物理系统都纳入到考虑范畴中。

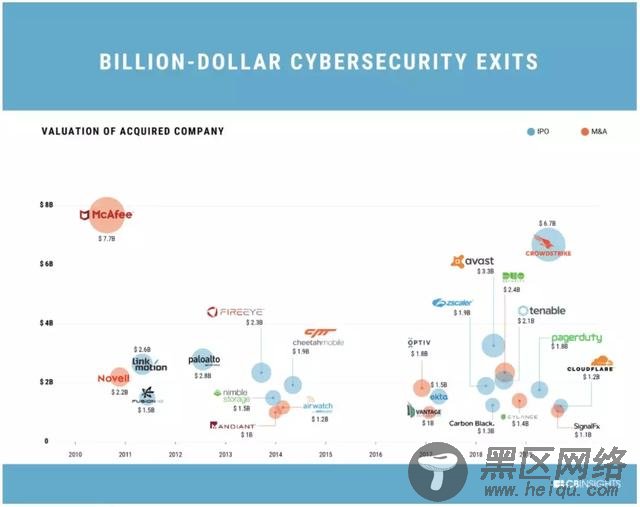

网络安全技术的发展将会帮助解决这些问题。总体来讲,网络安全领域依旧大热,尤其是在一系列初创公司并购和上市后。2017 年以来,有一系列的退出动作(如下图),为早期投资者带来了较为可观的收益。

(来源:CB Insights)

现在,我们依然在处在威胁之中,没有人能够幸免。新的范式必须以最坏的情况作为参考。我们要把安全看成在最坏的情况下保护一个公司或者政府机构的一把大伞,即使在这场巨大的风暴中我们需要承受一些损失。

乐观的人会说,2020 年,像杀戮无人机或者勒索软件等将刺激公共或私有机构采取更加有效的行动,来保证一定程度的安全;而悲观的人会说,只有当巨大的悲剧性损失发生的时候,人们才会意识到安全的重要性。

人工智能的偏见引发监管部门的高度关注人工智能常常被认为是克服人类会犯错这一问题的有效方法,但事实是,只有训练数据是好的的情况下才会发挥其积极的效用。有时候,当训练数据有很大信息鸿沟或者偏见的时候,人工智能就会“跑偏”,科技巨头的人工智能产品有时候也不能幸免。

亚马逊人工智能驱动的招聘工具被曝出其会过滤掉某些包含“女性的”关键词的简历;人们也发现,谷歌针对社交媒体中的仇恨言论监测算法会标示出某些黑人用户的推特,即使其内容并没有任何问题;最近苹果的信用卡也受到了人们谴责,因为其被指提供给男性的信用透支额度高于女性,从而引发了纽约州相关监管机构对此事件的调查。

图 | 由人工智能算法的偏见引发的争论正越来越多地引发媒体关注(来源:CB Insights)

为了应对越来越多的关注,科技公司也在积极制定公共人工智能指导方针。谷歌在退出饱受争议的美国军事合约项目 Maven 后,发布了其“人工智能准则”;微软定制的人工智能原则在公平、包容、隐私等方面都收到称赞;IBM 在其 2018 年发布的“未来五年内将改变生活的五项创新”中,提出了针对人工智能偏见的控制,强调要使用普世价值来训练人工智能。

但我们都知道,仅仅靠规则是不够的。2019 年以来,就已经表现出一定的迹象。如果政府监管参与进来,很可能就会出现美国高等法院或者欧洲高等法院对企业的测试、认证以及算法偏见纠正等环节进行监管。所以我们说,2020 年,针对人工智能和机器学习偏见的松散自控很可能会转变成政府监管。

2019 年 5 月,旧金山成为了美国第一个禁止城市政府使用面部识别的城市。而美国个别其他城市也颁发了类似的禁令。波特兰计划在 2020 年中提出一项最严格的禁令,旨在禁止包括私营企业在内的机构使用面部识别技术。

联邦政府、欧盟也都表现出对于人工智能偏见的重视。比如去年四月美国联邦议院提出的 “2019 算法问责法案”,以及欧盟的《通用数据保护法案》等。所以 2020 年,我们认为各个级别,从政府到企业的人工智能偏见规则将会出现。对企业来说,最好应用一种更加严格的人工智能开发规则,并在其中包括一些特定的条款来阻止偏见发生。

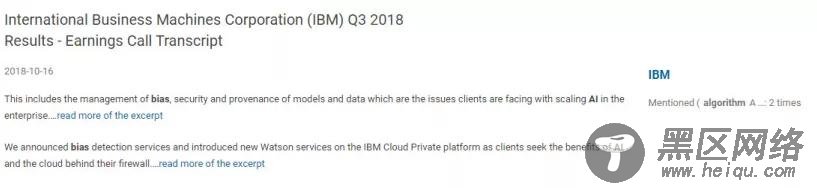

图 | 财报会议中提及“IBM 人工智能偏见”的次数(2018 年第三季度,来源:CB Insights)

或者,企业可以向外寻找更好的算法初创公司作为伙伴,来适应和遵守新的人工智能偏见监管条例。其中一个关注点是与提供“合成数据”的企业建立合作伙伴关系,这些提供“合成数据”的企业会将有可能有偏见的真实数据,使用特殊生成的合成数据进行替代,从而避免原数据有可能产生的偏见和语义鸿沟。 AI.Reverie 就是这样一家专攻“合成数据”的公司,旨在提供多样的图片和场景,来帮助算法生成更好、偏见更低的结果。这家公司名列 2019 年的 AI 100 榜单。